알림마당

보도자료

금융보안원, 「2025년 AI 레드팀 보고서」 발간

제목 : 금융보안원, 「2025년 AI 레드팀 보고서」 발간

- 2025년 금융권 AI 레드티밍 결과 공유, 2026년 AI 보안 전략 제시

- 보안 관리를 위한 기술과 내부통제의 통합적 대응 강조

□ 금융보안원(원장 박상원)은 AI 보안 위협에 대한 전망과 금융권 AI 레드팀의 2025년 활동 결과를 담은 「2025년 AI 레드팀 보고서(2025 FSI AI RED TEAM REPORT)」를 발간

|

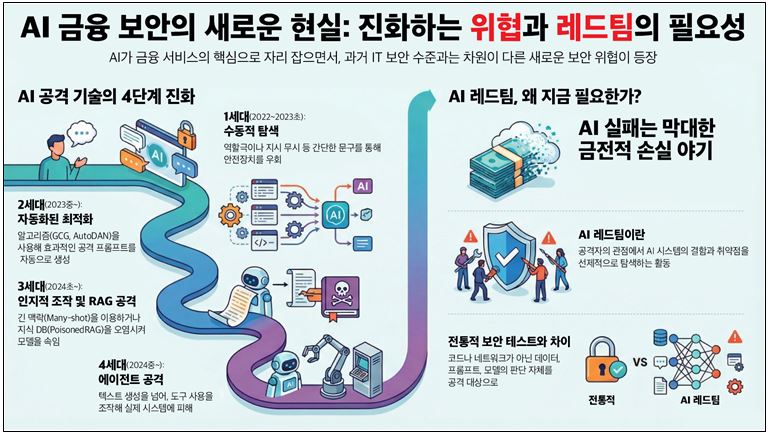

* AI 레드팀(AI Red Team): 공격자의 관점에서 AI 시스템 고유의 결함과 취약점을 선제적으로 탐색하는 테스트 활동인 AI 레드티밍(AI Redteaming)을 수행하는 조직 |

□ AI 공격 기술이 빠르게 진화하고, 공격의 파급력도 확대되고 있는 가운데 AI 레드티밍은 선택이 아닌 필수라는 인식이 확산

|

[ 세대별 AI 공격 기술 ] ➊ 1세대(수동적 탐색): 역할극 등 간단한 우회 문구(DAN 등)를 통해 AI의 윤리적 안전장치를 우회 ➋ 2세대(자동화된 최적화): 알고리즘(GCG, AutoDAN)을 사용하여 효과적인 공격 프롬프트를 자동으로 생성 ➌ 3세대(인지적 조작 및 RAG 공격): 긴 문맥을 이용하거나 지식 DB를 오염시켜 모델의 판단을 조작 ➍ 4세대(에이전트 공격): 도구 사용을 조작하여 실제 금융 시스템에 직접적인 피해를 유발 |

ㅇ 금융보안원은 AI 및 보안 관련 전문성을 바탕으로 `23년부터 연구를 시작해 `25년에는 국내 금융권 최초로 체계적 AI 레드티밍(금융 AI 모델 제3자 보안성 검증)을 수행

ㅇ 점검 결과, 금융권 AI는 단순 우회 문구 등 기본적인 위협에는 적절히 대응하나, 3세대 이상의 복합적이고 고도화된 최신 공격에는 무력화*되는 경향을 보였다고 설명

* 챗봇이 욕설을 내뱉은 사례, 조작된 뉴스 입력 가능성, AI 모델 및 설정 정보 유출 등

□ 아울러, 금융회사의 AI 관련 공격 탐지 및 방어 기술과 내부통제의 통합적 대응이 필요함을 역설하며 ➊AI 거버넌스 체계 확립, ➋에이전트 권한 검증, ➌주기적 AI 레드티밍 등을 제안

|

➊ AI 거버넌스 체계: AI 보안 전담 조직을 지정하고 책임 소재를 명확히 하여 기술적 방어 수단을 지속 및 개선함으로써 사고를 사전에 방지 ➋ 에이전트 권한 검증: AI가 특정 업무를 수행하도록 설계된 모듈인 에이전트가 시스템·데이터에 접근할 때, 허용 범위 내에서만 동작하도록 식별·인증·권한 부여·모니터링 권한을 검증 ➌ 주기적 AI 레드티밍: 주기적으로 AI 레드티밍을 실시해 잠재적 취약점을 사전에 탐지·수정하여 보안 사고를 예방하고 금융사의 평판과 신뢰도 제고 |

ㅇ AI 보안 관련 전담조직 및 인력 확보, AI 시스템 대상 공격의 실시간 탐지 및 차단 체계 구축 등 모범사례도 소개

□ 금융보안원은 `26년에 AI 레드팀 전담 조직을 본격 신설하여 AI 레드티밍을 보다 중점적으로 수행하고,

ㅇ AI 에이전트에 대한 점검도 강화하며, 금융회사가 자체적으로 AI 보안성을 강화할 수 있도록 다양한 지원*을 실시할 계획

* 금융에 특화된 AI 보안 평가지표, AI 통제(가드레일) 모델, AI 자동점검 도구 배포 등

□ 금융보안원 박상원 원장은 “2026년은 AI가 금융혁신의 핵심 경쟁력으로 자리 잡는 동시에, AI에 대한 고도화된 공격이 급증하는 시기가 될 것”이며,

ㅇ “금융보안원은 금융회사가 안전하게 AI를 활용할 수 있도록 전담 조직을 통해 선제적인 보안 점검과 자체 검증 체계를 지원해 나가겠다.”라고 밝힘. 끝.

[별첨] 2025 FSI AI 레드팀 보고서 1부